Faut-il brûler les interfaces utilisateurs ?

Auteur(s)

Date

Partager

Résumé

On s’inquiéterait, à juste titre, qu’un juriste puisse discourir doctement sans jamais avoir lu la moindre ligne d’un code civil ou pénal. Mais on ne s’inquiète pas d’une telle situation, tout aussi affligeante, dans l’univers des médias et de la communication.

Auteur(s)

Date

Partager

Résumé

On s’inquiéterait, à juste titre, qu’un juriste puisse discourir doctement sans jamais avoir lu la moindre ligne d’un code civil ou pénal. Mais on ne s’inquiète pas d’une telle situation, tout aussi affligeante, dans l’univers des médias et de la communication.

Notre appréhension de l’information serait-elle foncièrement différente si la manière dont elle nous était quotidiennement affichée était non-graphique et non interfacée ? La question peut sembler, au mieux cocasse, voire saugrenue, au pire complètement farfelue, mais pourtant elle n’est pas dénuée d’un vrai questionnement sous-jacent sur la manière dont notre accès à l’information conditionne notre rapport à cette dernière. Et si une partie des discours qui structurent aujourd’hui notre univers mental associé aux nouveaux vecteurs de diffusion d’informations, que sont les applications social media notamment, pâtissaient, pour une large frange d’entre eux, d’un biais originel lié à la non prise en compte des interfaces utilisateurs. Des interfaces utilisateurs qui, à grand renfort de simplicité, d’optimisation technique et de génie des designers UX/UI de la côte Ouest (et chinois maintenant que TikTok est aussi hypé), ont contribué à évacuer tout rapport tangible aux raw et au brutal, à savoir le code, pour utiliser un terme très générique, sur lequel ces édifices sont bâtis. Une invisibilisation du soubassement matériel qui n’a rien de moralement condamnable bien entendu, de la même manière que nous n’avons pas, dans l’absolu, forcément besoin de voir l’association béton et acier qui compose les structures en béton armé des immeubles. D’un autre côté, que vaudrait un discours sur les bâtiments qui ferait l’impasse sur cette structure majeure, pour ne porter que sur la façade ? Au mieux un discours parcellaire et hémiplégique, au pire un discours éthéré.

Deux clics n’aboliront jamais le complexe

À titre d’exemple, et de préambule, il suffit de constater que pour faire un tweet aujourd’hui, un utilisateur d’un iPhone doté de Face ID (système de reconnaissance faciale propriétaire d’Apple, qui équipe les smartphones et les dernières générations d’iPad de la marque à la pomme) n’a que 2 clics à faire. Un sur l’application Twitter. Un sur le bouton “Tweeter”. “Eh voilà”, comme disent les anglo-saxons. Ce qui vaut pour Twitter, vaut également pour tous les autres réseaux sociaux, même si sur Instagram, TikTok ou encore Snapchat, un peu plus de 2 clics sont, dans l’absolu, nécessaires. De la même manière, et en inversant la logique, nous sommes assaillis de notifications push qui pénètrent notre périmètre informationnel sans être sollicitées. Dans les deux cas, l’utilisateur est passif dans son rapport aux interfaces. Passif, car il publie un tweet sans mesurer ce que cela implique en termes d’architecture logicielle et d’infrastructure serveur. Passif car il reçoit une notification qui “pop” sur son écran de manière quasiment magique. Dans les deux cas, les interfaces proposées sont extrêmement simples. Elles sont d’ailleurs d’autant plus simples, et cela ne doit pas manquer de nous questionner, au-delà du seul champ de l’UX/UI design, que les interfaces desktop s’inspirent des interfaces mobiles. Cela est notamment visible sur Twitter que ce soit tant en termes d’interface, qu’en termes d’url. Les deux URL ci-dessous devraient, en principe, nous renvoyer sur la version desktop pour la première, et mobile pour la seconde, comme cela a longtemps été le cas sur Twitter :

Or, les deux sont devenues strictement identiques, rendant à cet effet l’utilisation du “mobile” avant le nom du site totalement inutile.

Les assistants vocaux finiront par abolir le tangible (enfin, quand elles auront une “vraie” IA)

À terme, et bien qu’il n’existe visiblement (et bizarrement) pas encore de projets de ce type, on pourrait très bien imaginer qu’un tweet soit rendu parfaitement “immatériel” en utilisant un assistant vocal type Alexa ou Siri. Ces dispositifs sont encore aujourd’hui extrêmement rudimentaires (par exemple Alexa, l’assistant d’Amazon, pioche toute une partie de ses réponses dans Wikipédia), mais des versions plus évoluées pourraient très bien s’interfacer avec les APIs de réseaux sociaux comme Twitter, à condition de mettre de côté les enjeux de protection des données. De même que Twitter peut être utilisé directement via la ligne commande d’un terminal Bash sur Linux ou OSX, en utilisant des client URL request library (curl ou sa version développée spécifiquement par Twitter twurl), pour interagir avec l’API via des requêtes GET (pour résumer à grands traits celle qui permet de récupérer des données d’un serveur distant via le serveur à l’origine de la demande) ou POST (qui permet de créer de nouvelles ressources, en l’espèce d’envoyer une chaîne de caractères par exemple). Ce qui vaut pour Twitter, vaut également pour des applications de messagerie comme Telegram par exemple, qui ne manque pas de projets mis en ligne sur les différents Git (essentiellement GitHub et GitLab) pour contourner la surcouche graphique de l’application, et adosser des scripts (essentiellement rédigés en Python) pour publier directement en ligne de commande sur Telegram, créer des bots et autres scripts plus ou moins développés. En d’autres termes, contourner l’interface applicative, loin d’être une geekerie useless, permet d’une part de comprendre comment fonctionne cette dernière réellement, de tirer partie des potentialités natives qu’elle offre et de l’autre, et dans la mesure du possible, de rééquilibrer le rapport “machine” – homme”.

L’éthique du “hacker”, n’est pas stérile

Mais pourquoi donc revenir à la “préhistoire” de l’informatique, quand la seule manière d’utiliser un ordinateur, avec un écran en tube cathodique, consistait à utiliser la console, une interface textuelle permettant d’interagir avec l’OS ? Parce que cela permettrait d’éviter, très certainement, bien des erreurs, bien des fantasmes et bien des errements, quant à notre manière de discourir sur les “nouveautés” qui ébranleraient complètement et supposément le rapport homme-machine. Quelques notions rudimentaires en programmation, en bash par exemple, permettent assez vite de comprendre qu’un script qui s’exécute de manière automatique, soit au démarrage du serveur, soit selon un cycle défini (ou à heure/date fixe) via l’utilisation d’un programme type cron (un planificateur de tâches en ligne de commande), quelques instructions conditionnelles (IF → then → else) ne ressort pas forcément du domaine de l’intelligence artificielle. De la même manière, et bien que cela devienne de plus en plus compliqué du fait des dispositifs implémentés ces derniers mois par Twitter, un script interagissant avec l’API du réseau social selon une série d’instructions, plus ou moins développées, ne permettra jamais d’aller bien loin. Il pourra facilement automatiser des retweets, partager des articles issus de sources prédéfinies, mais malgré tous les discours sur l’intelligence artificielle, aucun dispositif ne permet aujourd’hui d’automatiser le langage naturel. Cela relève encore du fantasme, bien que de nombreux secteurs, parmi lesquels figurent notamment le monde de médias, pourraient évidemment être complètement chamboulés par ce type de dispositif, plus uniquement borné à des articles automatiques sur le résultat d’un match de football ou la météo du jour. À ce stade, en abolissant les soubassements techniques, sur lesquels reposent entièrement les applications que nous utilisons quotidiennement, l’UX/UI tend à rendre une partie des utilisateurs complètement ignorants. Nous pouvons évidemment très bien utiliser une voiture sans nous intéresser au fonctionnement d’un moteur à combustion et explosion. Nous pouvons également très bien aller pêcher à la ligne avec un moulinet à tambour fixe ou tournant, sans chercher à comprendre comment ils fonctionnent. Par contre, cette ignorance devient contrariante lorsque les dispositifs s’enrayent et deviennent inutilisables.

La primauté de la démarche utilitaire sur l’intelligibilité des dispositifs techniques, ou, pour le dire autrement, la primauté de l’éthique du consommateur sur l’éthique du bidouilleur (ou hacker pour faire plus chic) donne lieu une situation de passivité généralisée, tendant à créer un rapport diamétralement asymétrique entre l’homme et la machine. Une passivité qui devient problématique lorsqu’elle se dote d’une surcouche, non pas logicielle, mais intellectuelle (philosophique, sociologique…). Cette surcouche à un nom : les experts en toutologie qui discourent doctement de l’impact social, politique ou psychologique des nouvelles technologies, sans même comprendre les soubassements techniques de l’objet de leur (chère) attention. Que valent les discours sur les bulles de filtres, sans essais techniques et itératifs permettant de tester grandeur nature la manière dont les algorithmes réagissent effectivement en fonction d’itinéraires informationnels aléatoires ? Pas grand chose. La simplicité, nécessaire pour focaliser et garder au maximum l’attention des utilisateurs sur les plateformes, découlant des travaux en UX/UI crée donc au mieux des boîtes noires, au pire une pseudo “immatérialité” ou “irréalité” technique, qui ne peut que produire à la chaîne de la pensée magique. Si le bullshit sur l’IA, au mieux risible lorsqu’il essaime sur LinkedIn, au pire affolant lorsqu’il est repris par les décideurs politiques, a eu autant de succès ces dernières années, avec tout ce que cela implique sur notre appréhension des mutations dans l’écosystème informationnel, cela vient de cette rupture ontologique avec ce qui constitue la matérialité concrète de l’Internet. Cachez moi ces warehouses de serveurs que je ne saurais voir. Cachez moi ces câbles que je ne saurais voir. Et surtout, cachez moi ce code que je ne saurais voir (ni lire). On s’inquiéterait, à juste titre, qu’un juriste puisse discourir doctement sans jamais avoir lu la moindre ligne d’un code civil ou pénal. Mais on ne s’inquiète pas d’une telle situation, tout aussi affligeante, dans l’univers des médias et de la communication.

Notre appréhension de l’information serait-elle foncièrement différente si la manière dont elle nous était quotidiennement affichée était non-graphique et non interfacée ? La question peut sembler, au mieux cocasse, voire saugrenue, au pire complètement farfelue, mais pourtant elle n’est pas dénuée d’un vrai questionnement sous-jacent sur la manière dont notre accès à l’information conditionne notre rapport à cette dernière. Et si une partie des discours qui structurent aujourd’hui notre univers mental associé aux nouveaux vecteurs de diffusion d’informations, que sont les applications social media notamment, pâtissaient, pour une large frange d’entre eux, d’un biais originel lié à la non prise en compte des interfaces utilisateurs. Des interfaces utilisateurs qui, à grand renfort de simplicité, d’optimisation technique et de génie des designers UX/UI de la côte Ouest (et chinois maintenant que TikTok est aussi hypé), ont contribué à évacuer tout rapport tangible aux raw et au brutal, à savoir le code, pour utiliser un terme très générique, sur lequel ces édifices sont bâtis. Une invisibilisation du soubassement matériel qui n’a rien de moralement condamnable bien entendu, de la même manière que nous n’avons pas, dans l’absolu, forcément besoin de voir l’association béton et acier qui compose les structures en béton armé des immeubles. D’un autre côté, que vaudrait un discours sur les bâtiments qui ferait l’impasse sur cette structure majeure, pour ne porter que sur la façade ? Au mieux un discours parcellaire et hémiplégique, au pire un discours éthéré.

Deux clics n’aboliront jamais le complexe

À titre d’exemple, et de préambule, il suffit de constater que pour faire un tweet aujourd’hui, un utilisateur d’un iPhone doté de Face ID (système de reconnaissance faciale propriétaire d’Apple, qui équipe les smartphones et les dernières générations d’iPad de la marque à la pomme) n’a que 2 clics à faire. Un sur l’application Twitter. Un sur le bouton “Tweeter”. “Eh voilà”, comme disent les anglo-saxons. Ce qui vaut pour Twitter, vaut également pour tous les autres réseaux sociaux, même si sur Instagram, TikTok ou encore Snapchat, un peu plus de 2 clics sont, dans l’absolu, nécessaires. De la même manière, et en inversant la logique, nous sommes assaillis de notifications push qui pénètrent notre périmètre informationnel sans être sollicitées. Dans les deux cas, l’utilisateur est passif dans son rapport aux interfaces. Passif, car il publie un tweet sans mesurer ce que cela implique en termes d’architecture logicielle et d’infrastructure serveur. Passif car il reçoit une notification qui “pop” sur son écran de manière quasiment magique. Dans les deux cas, les interfaces proposées sont extrêmement simples. Elles sont d’ailleurs d’autant plus simples, et cela ne doit pas manquer de nous questionner, au-delà du seul champ de l’UX/UI design, que les interfaces desktop s’inspirent des interfaces mobiles. Cela est notamment visible sur Twitter que ce soit tant en termes d’interface, qu’en termes d’url. Les deux URL ci-dessous devraient, en principe, nous renvoyer sur la version desktop pour la première, et mobile pour la seconde, comme cela a longtemps été le cas sur Twitter :

Or, les deux sont devenues strictement identiques, rendant à cet effet l’utilisation du “mobile” avant le nom du site totalement inutile.

Les assistants vocaux finiront par abolir le tangible (enfin, quand elles auront une “vraie” IA)

À terme, et bien qu’il n’existe visiblement (et bizarrement) pas encore de projets de ce type, on pourrait très bien imaginer qu’un tweet soit rendu parfaitement “immatériel” en utilisant un assistant vocal type Alexa ou Siri. Ces dispositifs sont encore aujourd’hui extrêmement rudimentaires (par exemple Alexa, l’assistant d’Amazon, pioche toute une partie de ses réponses dans Wikipédia), mais des versions plus évoluées pourraient très bien s’interfacer avec les APIs de réseaux sociaux comme Twitter, à condition de mettre de côté les enjeux de protection des données. De même que Twitter peut être utilisé directement via la ligne commande d’un terminal Bash sur Linux ou OSX, en utilisant des client URL request library (curl ou sa version développée spécifiquement par Twitter twurl), pour interagir avec l’API via des requêtes GET (pour résumer à grands traits celle qui permet de récupérer des données d’un serveur distant via le serveur à l’origine de la demande) ou POST (qui permet de créer de nouvelles ressources, en l’espèce d’envoyer une chaîne de caractères par exemple). Ce qui vaut pour Twitter, vaut également pour des applications de messagerie comme Telegram par exemple, qui ne manque pas de projets mis en ligne sur les différents Git (essentiellement GitHub et GitLab) pour contourner la surcouche graphique de l’application, et adosser des scripts (essentiellement rédigés en Python) pour publier directement en ligne de commande sur Telegram, créer des bots et autres scripts plus ou moins développés. En d’autres termes, contourner l’interface applicative, loin d’être une geekerie useless, permet d’une part de comprendre comment fonctionne cette dernière réellement, de tirer partie des potentialités natives qu’elle offre et de l’autre, et dans la mesure du possible, de rééquilibrer le rapport “machine” – homme”.

L’éthique du “hacker”, n’est pas stérile

Mais pourquoi donc revenir à la “préhistoire” de l’informatique, quand la seule manière d’utiliser un ordinateur, avec un écran en tube cathodique, consistait à utiliser la console, une interface textuelle permettant d’interagir avec l’OS ? Parce que cela permettrait d’éviter, très certainement, bien des erreurs, bien des fantasmes et bien des errements, quant à notre manière de discourir sur les “nouveautés” qui ébranleraient complètement et supposément le rapport homme-machine. Quelques notions rudimentaires en programmation, en bash par exemple, permettent assez vite de comprendre qu’un script qui s’exécute de manière automatique, soit au démarrage du serveur, soit selon un cycle défini (ou à heure/date fixe) via l’utilisation d’un programme type cron (un planificateur de tâches en ligne de commande), quelques instructions conditionnelles (IF → then → else) ne ressort pas forcément du domaine de l’intelligence artificielle. De la même manière, et bien que cela devienne de plus en plus compliqué du fait des dispositifs implémentés ces derniers mois par Twitter, un script interagissant avec l’API du réseau social selon une série d’instructions, plus ou moins développées, ne permettra jamais d’aller bien loin. Il pourra facilement automatiser des retweets, partager des articles issus de sources prédéfinies, mais malgré tous les discours sur l’intelligence artificielle, aucun dispositif ne permet aujourd’hui d’automatiser le langage naturel. Cela relève encore du fantasme, bien que de nombreux secteurs, parmi lesquels figurent notamment le monde de médias, pourraient évidemment être complètement chamboulés par ce type de dispositif, plus uniquement borné à des articles automatiques sur le résultat d’un match de football ou la météo du jour. À ce stade, en abolissant les soubassements techniques, sur lesquels reposent entièrement les applications que nous utilisons quotidiennement, l’UX/UI tend à rendre une partie des utilisateurs complètement ignorants. Nous pouvons évidemment très bien utiliser une voiture sans nous intéresser au fonctionnement d’un moteur à combustion et explosion. Nous pouvons également très bien aller pêcher à la ligne avec un moulinet à tambour fixe ou tournant, sans chercher à comprendre comment ils fonctionnent. Par contre, cette ignorance devient contrariante lorsque les dispositifs s’enrayent et deviennent inutilisables.

La primauté de la démarche utilitaire sur l’intelligibilité des dispositifs techniques, ou, pour le dire autrement, la primauté de l’éthique du consommateur sur l’éthique du bidouilleur (ou hacker pour faire plus chic) donne lieu une situation de passivité généralisée, tendant à créer un rapport diamétralement asymétrique entre l’homme et la machine. Une passivité qui devient problématique lorsqu’elle se dote d’une surcouche, non pas logicielle, mais intellectuelle (philosophique, sociologique…). Cette surcouche à un nom : les experts en toutologie qui discourent doctement de l’impact social, politique ou psychologique des nouvelles technologies, sans même comprendre les soubassements techniques de l’objet de leur (chère) attention. Que valent les discours sur les bulles de filtres, sans essais techniques et itératifs permettant de tester grandeur nature la manière dont les algorithmes réagissent effectivement en fonction d’itinéraires informationnels aléatoires ? Pas grand chose. La simplicité, nécessaire pour focaliser et garder au maximum l’attention des utilisateurs sur les plateformes, découlant des travaux en UX/UI crée donc au mieux des boîtes noires, au pire une pseudo “immatérialité” ou “irréalité” technique, qui ne peut que produire à la chaîne de la pensée magique. Si le bullshit sur l’IA, au mieux risible lorsqu’il essaime sur LinkedIn, au pire affolant lorsqu’il est repris par les décideurs politiques, a eu autant de succès ces dernières années, avec tout ce que cela implique sur notre appréhension des mutations dans l’écosystème informationnel, cela vient de cette rupture ontologique avec ce qui constitue la matérialité concrète de l’Internet. Cachez moi ces warehouses de serveurs que je ne saurais voir. Cachez moi ces câbles que je ne saurais voir. Et surtout, cachez moi ce code que je ne saurais voir (ni lire). On s’inquiéterait, à juste titre, qu’un juriste puisse discourir doctement sans jamais avoir lu la moindre ligne d’un code civil ou pénal. Mais on ne s’inquiète pas d’une telle situation, tout aussi affligeante, dans l’univers des médias et de la communication.

Quels sont les ressorts objectifs et quantifiables à l’origine de cette volonté de réguler les réseaux sociaux ?

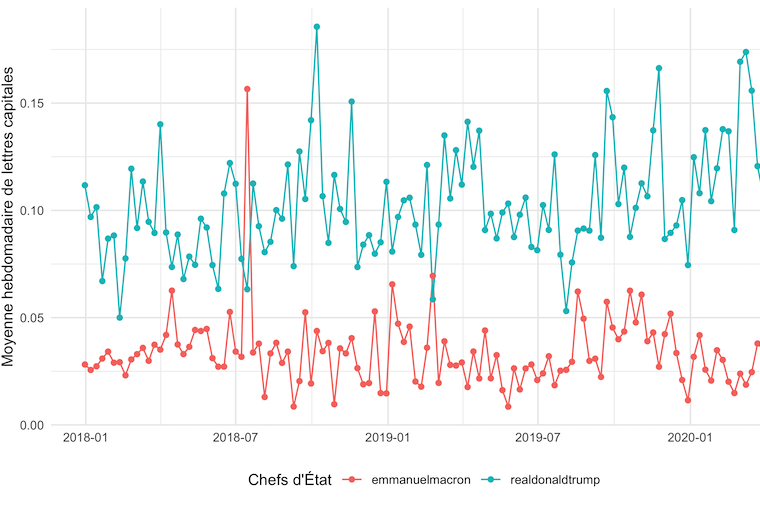

Création d’un modèle de classification de tweets basé sur l’utilisation des lettres capitales dans une série de publications.

Entretien avec Jean-Christophe Gatuingt, co-fondateur de Visibrain, sur les bouleversements en cours sur les réseaux sociaux.

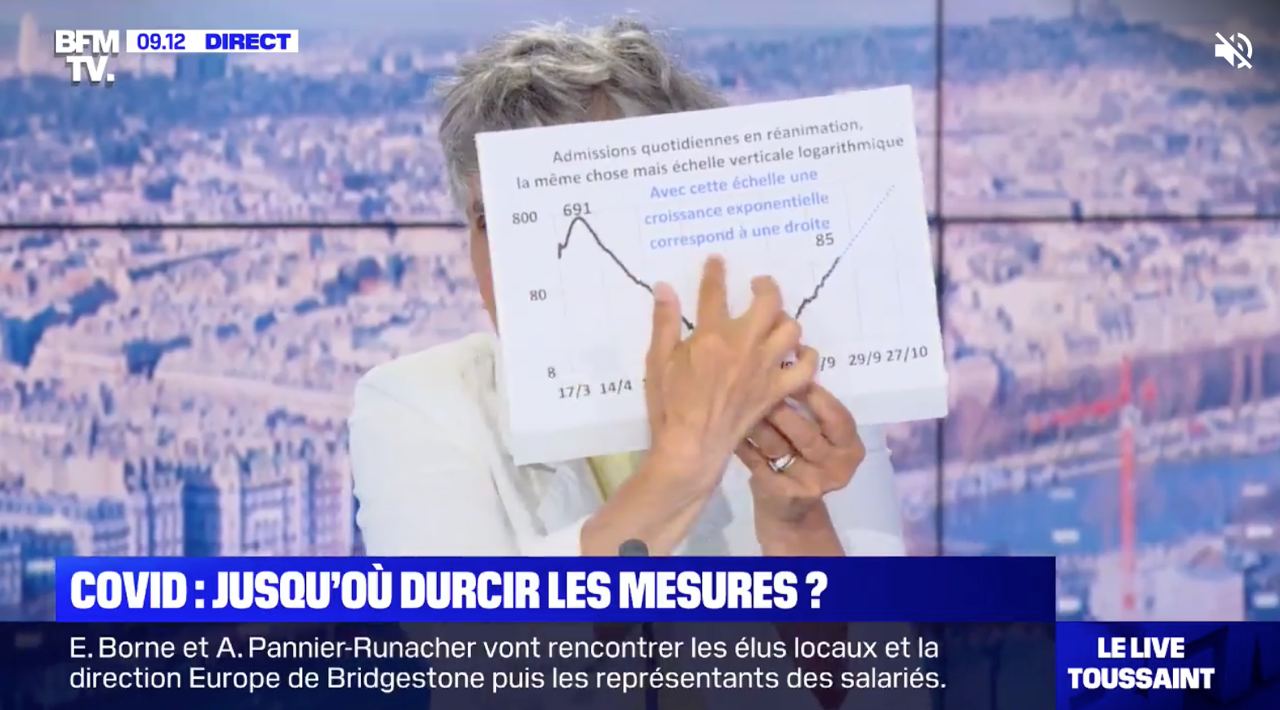

Il est à soupçonner fortement que le confinement dans sa première version, que nous décrivions dans sa phase terminale comme un « problème moral et politique », a probablement débuté sa carrière sur le marché des solutions politiques, de manière souterraine dans le domaine de la mystique, et s’y tiendra tapis à chaque accalmie, attendant son heure pour ressurgir comme un vampire.